——

人脸识别技术(Face Recognition Technology)是一种基于人的脸部特征信息进行身份识别或身份验证的生物特征识别技术。它在场景化的过程中改变了人的生活习惯和行为方式,为社会发展带来新机遇。然而,人脸识别技术的落地模式仍未成熟,信息隐私泄露问题频发,导致技术难以大规模推广。

近年来各国相继出台法案、禁令来规范人脸识别技术与人脸信息的应用,但是相关的法律规制并无统一模式,在价值取向上略有差异。如美国旧金山出台法令全面禁止当地政府部门使用人脸识别技术,形成了“禁止使用”的法律规制模式,更关注公民的隐私和自由权利;又如,“英国人脸识别第一案”的判决认为政府在遵循数据保护法的前提下,可以有限度地使用人脸识别技术,肯定了“基于公共利益的正当使用”的法律规制模式,更侧重于社会利益的最大化;还有,欧盟《通用数据保护条例》要求严格规范运营商的行为界限,形成了“基于经济利益的限制使用”的法律规制模式,更倾向于人脸信息经济价值的实现[1]。目前,中国关于人脸信息的保护性规定散见于《民法典》《数据安全法》《个人信息保护法》等法律法规中,未形成专门规范人脸识别应用的高阶位、系统的法律[2]。如何妥善处理人脸信息利用与隐私保护之间的关系问题成为了国内法学研究的热点。

法律规制模式的差异,体现了价值取向的不同,也体现了相关主体利益协调与分配的分歧,归根到底是伦理价值的争论。人脸信息的收集、整合和利用不仅涉及到个人权益的法律保护,还涉及到利益是否合理正当的伦理评判。人脸信息承载着个人隐私,是个人权益和人格尊严的一部分[3],应当给予充分的尊重和保护。但是,在数字经济时代,若各界对人脸信息保护得过分严苛,会影响技术推广的积极性和创新动力,不利于社会效益的最大化。如何维护个人权益,同时发挥人脸信息的效益,逐渐成为人与技术协调发展过程中的一大伦理困境。这一困境在急速发展的智能社会显得更为突出,也是技术应用的实践过程中亟待审慎解决的问题。

一、人脸信息的本质与双重属性随着计算机图形学、图像处理的发展,在大数据、物联网和人工智能等新一代信息技术的助力下,人脸识别技术的直接产物——人脸数据——能够与各类数据融合互联、交叉引用和深度创造,形成具有使用价值和隐私价值的人脸信息。人脸信息本质上是以数据形式记录的,与特定自然人有关的生物识别信息,一定程度上与该自然人既往社会评价、名誉等人格利益相关联[4],蕴含着丰富的财产价值[5],具有私有属性和共有属性。人脸信息隐私保护实质上是对具有隐私属性的人脸信息进行保护。

人脸信息承载着重要的人身、财产等个人权益,表现出强烈的私有属性。人脸识别技术通过利用面部特征进行数字认证,连接物理世界和数字世界的自我,从而保证数字身份的真实性。人脸信息不仅具有人身反映性和直接指向性,还能与财产、机器设备等构成特殊关联,如“刷脸”支付。个人有权自主决定以何种目的或何种方式使用人脸信息,并为个人带来各种利益价值。

人脸信息是人脸识别技术发展和应用的基础,又表现出共有属性。长期的、巨量的人脸信息投喂,能够为人脸识别技术发展提供新的数据材料,促进技术性能的升级换代。而且,人脸信息能够与商业模式、民生场景紧密结合,进一步释放技术红利。如在公共安全领域,人脸信息就用于追踪定位犯罪嫌疑人,在刑事案件中发挥重要作用。因此,共有属性不仅体现在人脸信息为人脸识别技术的发展提供了材料支撑上,还体现为人脸信息与各种信息的相互融合与快速交换,以降低交易成本,促进经济和社会的发展[6]。

因此,人脸信息兼具私有属性和共有属性,为实现个人权益时以私用形式使用,而为实现社会效益时以共用形式使用。它的有效利用,要求二者同等重要且相互作用。本质上来说,它是一种半公地资源。

二、从半公地理论看伦理困境的生成半公地资源是一种介于纯公共资源和纯私有资源之间的混合资源类型。亨利·史密斯(Henry Smith)认为,现实资源通常兼具“共有”(common ownership)和“私有”(private ownership)两种属性[7],由主导属性划分公共资源或私有财产:当共有属性占据主导地位,该资源可以看作是公共资源;当私有属性占据主导地位时,该资源可以看作是私有财产;当一种资源的有效利用要求两种属性并存且相互作用时,可以视其为一种半公地资源(semicommons)[8]。它为实现某个目的时以私用的形式拥有和使用,或为实现其它目的以共用的形式拥有和使用[7]。

1. 半公地理论与半公地悲剧史密斯结合了中世纪英国的敞田制,论述了半公地原始模型。之后,贝尔塔基尼(Bertacchini E.)[9]等人从博弈论角度进一步分析半公地悲剧。

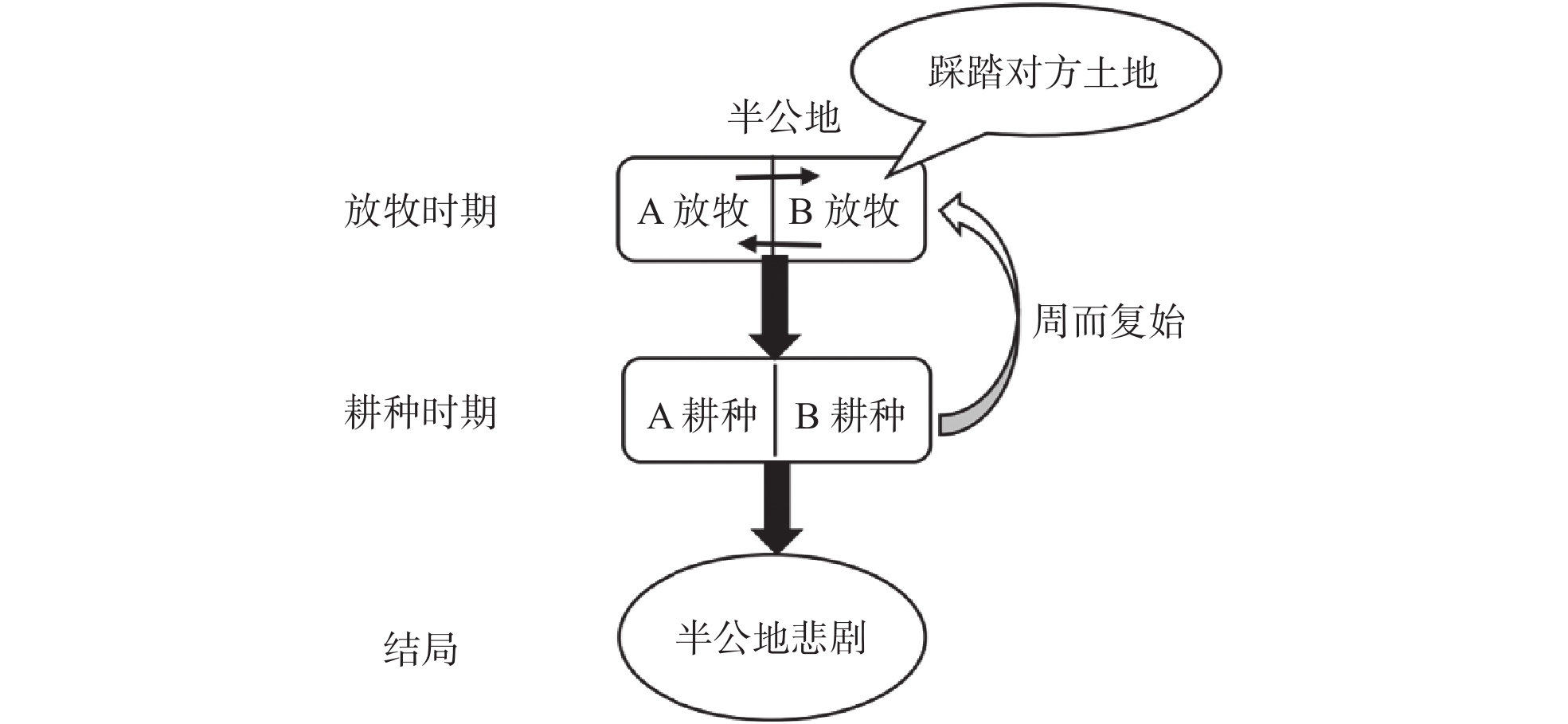

在敞田制中,农民从庄园领主处分配到大小不均、肥瘦不同的条田。田地资源的属性由土地的使用目的而决定:在耕种时期,农民可以在条田里进行耕种并获取收成,条田表现出私有属性;但是庄园领主规定在休耕期,条田对所有农民开放,农民可以任意放牧,条田表现出共有属性。

为了简化分析过程并建立博弈模型,贝尔塔基尼等人假设,监督机制缺失的前提下,仅有农民A和农民B两位“理性”的资源使用者

|

图 1 贝尔塔基尼等的博弈模型分析示意图 |

总之,从半公地理论看,资源有两种不同的使用方式,且这两种方式相互作用。但人们常常只关注私有部分,采取机会主义行为,忽视了资源的公共使用对私人使用造成的影响,出现半公地悲剧现象。

2. 人脸信息面临的半公地悲剧现实生活中,相当多的资源呈现出半公地资源特征。自史密斯提出半公地理论后,学者们逐渐将这一理论运用到现实问题的研究中,如赫弗利·罗伯特(Heverly Robert A.)就用来分析现代信息资源[10],付大学进一步地用来解释个人信息的半公地悲剧[11]。笔者看来,人脸信息作为一种半公地资源,也面临着半公地悲剧。

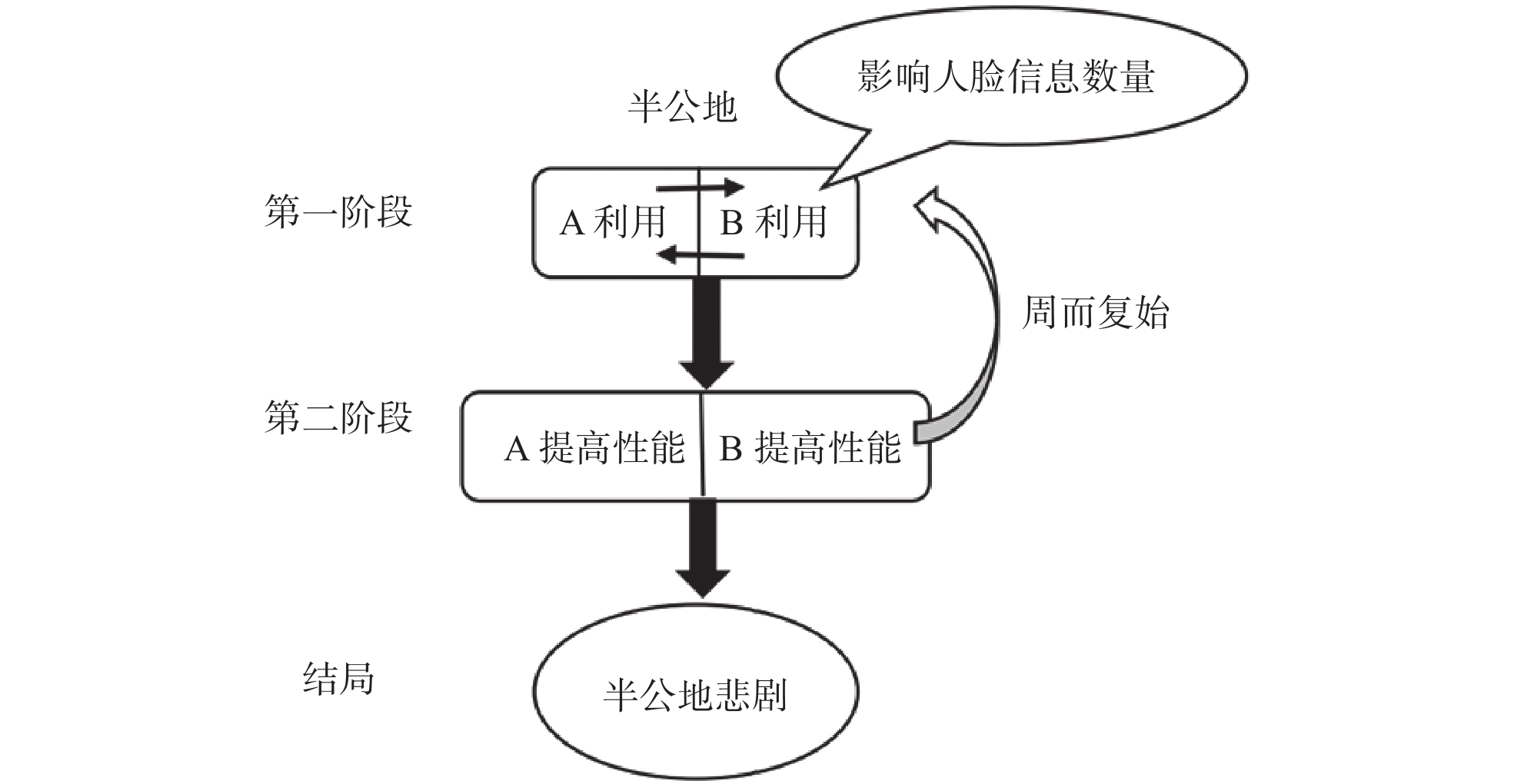

敞田制中,土地资源量的补充源于自我恢复。人脸信息资源的补充源于信息主体对人脸识别技术的“信任”[12],数量多寡则取决于主体共享信息的意愿[13]。根据贝尔塔基尼等人的博弈模型,人脸信息的博弈分成两个阶段。第一阶段,人脸信息的共有属性占据主导地位,人脸信息处于共用状态,信息处理者根据自身需要整合和利用信息;第二阶段,人脸信息的私有属性占据主导地位,人脸信息处于私用状态,信息处理者可以通过更新数据以提高技术性能。第一阶段人脸信息的利用情况影响第二阶段信息主体的使用意愿。

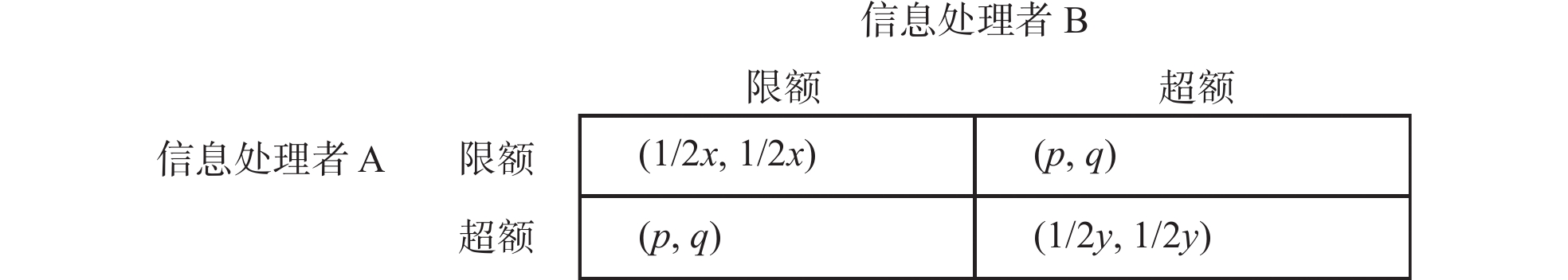

博弈的第一阶段,信息处理者A和信息处理者B分别有超额使用或限额使用的策略选择。若A超额使用而B限额使用,则A的收益为p,B的收益为q(p>q);若A限额使用而B超额使用,则A的收益为q,B的收益为p;若双方同时选择限额使用,则A、B的收益为总收益x的一半,即1/2x(x>p+q,p>1/2x且q>1/2x);若双方都选择超额使用,则A、B的收益为1/2y(y<x)。该博弈用支付矩阵展示如图2所示。

|

图 2 信息共享状态的支付矩阵图 |

当博弈出现(限额,超额)与(超额,限额)两组纳什均衡解,资源使用的总数量都超过资源的帕累托最优数量,信息处理者会基于自身利益最大化的诉求,过度整合与利用人脸信息创造收益,如降低数据安全的投入、利用人脸信息进行价格歧视等[12]。人脸信息的不当利用伴随着一系列的风险隐患,信息主体遭受风险困扰或损失时,难以向特定的信息处理者追责,导致了本应由特定信息处理者承担的成本,实际上由其他信息处理者或整个行业负担了,从而影响到信息主体对信息共享的信任。在博弈的第二阶段,信息主体就会考虑到上一阶段遭受的损失,降低共享信息的意愿。如此周而复始,信息主体对共享的信心会随着博弈的进行而消失殆尽,人脸识别事业的发展就会遭遇阻碍,呈现出半公地悲剧。人脸信息面临的半公地悲剧用简易示意图3来表示。

|

图 3 人脸信息面临的半公地悲剧示意图 |

这一半公地悲剧清晰地表明,个人理性行为的积累不一定会出现集体理性的结果。一方面,现阶段公众的权利意识不足、信息素养仍待提高。若将隐私保护的主动权完全交给信息主体,给予主体“绝对”的权利,会导致人脸信息不能真正发挥作用和价值。另一方面,信息处理者会出于利益最大化的诉求而选择自利的博弈策略,忽视伦理价值对理性行为的引导与约束。

3. 伦理困境的原因剖析从半公地理论看,人脸信息隐私保护的伦理困境的生成有多重原因:一是人脸识别场景化存在多元利益冲突,二是现行保护路径有效性受到质疑,三是相关主体伦理责任的缺失。

首先,人脸识别场景化的过程,是利益多元化的生成过程,也是多元利益冲突日益凸显的过程。在人脸信息隐私保护中,相关利益主体包括政府及其决策者、企业、科技工作者和公众等,呈现出多元主体的特征。从长远利益来看,他们之间存在共同的利益诉求和期望,即满足主体发展需要,广泛享受技术红利;同时,他们还是具有不同特殊利益和价值倾向的独立主体,在维护与实现自身利益过程中,不可避免地与其他主体产生利益冲突。例如,企业更注重利润收益,挖掘人脸信息以优化经营策略;而公众提供个人信息,享受产品和服务,但需要承担企业利用信息不当造成的隐私泄露风险。因此,多元利益的冲突给人脸信息隐私保护带来了巨大挑战。

其次,以个人权利为进路的隐私保护措施面临“知情同意”有效性质疑[14]。目前,国内外形成了以“知情同意”为基础的现行法律框架,如美国伊利诺伊州《生物识别信息隐私法案》、欧盟《通用数据保护条例》和中国《个人信息保护法》均规定,处理包括人脸信息在内的生物识别信息,必须征得个人单独同意。可见,“知情同意”是个人信息处理的合法性基础。然而,我们要进一步考虑的是,现实生活中真实有效的“知情同意”往往很难落实。一方面,由于信息处理者与信息主体处于信息不对称的地位,信息处理者会从自身利益最大的角度出发,规避法律风险,制定知情同意规则;而信息主体群体庞大,认识能力存在差异,容易抱有侥幸心理满足当下利益或需求,忽视未来的风险。另一方面,过于复杂和专业化的表述将使得“知情”流于形式,形式化、专业性较强、篇幅较长的条文和一键式操作让大多数用户不得不按下“同意键”。海量信息的批量处理、多方共享、目的不特定之频繁利用也加大了有效同意获取的难度[15],“知情同意”作为个人信息处理的有效前提受到了质疑。

最后,在价值多元化与利益纷争的现代社会,相关伦理责任的缺失加剧了科技理性与价值理性的分离。受到政府或其他决策者和企业的利益诉求、科技工作者的价值偏见以及公众的消费偏好等影响,人脸识别技术落地过程缺乏伦理约束。它大多以设计者、应用方的满意程度,即预见与结果的契合程度为评价标准,将人脸信息与具有独立人格、享有人格尊严的人割裂开来,转化为数字或代码,储存在海量数据库中。如此一来,人的自由与价值得不到应有的重视,出现了以科学技术为核心的科学文化与以人的价值和尊严维护为核心的人文文化的背离现象[16]。

三、人脸信息隐私保护的伦理原则人脸信息利用引发的伦理争议,根本上是缘自其场景化过程缺乏伦理价值考量,因此我们更应予以充分的伦理关照。人脸信息隐私保护的伦理困境的生成具有特殊性,呼唤新的伦理原则。

1. 人脸信息隐私保护的特殊性分析关于人脸信息隐私保护路径,学界主要存在三种观点。有人认为,人脸信息不能被隐私所涵盖,侵权保护势必借助个人信息的保护路径[17]。也有人认为,人脸信息的利用可能会使一些原不属于隐私的个人信息成为隐私,需要重新界定隐私的边界[18]。还有人认为,单独个人生物识别信息的保护可以适用于隐私权规范,但涉及数据控制者的则应当适用个人信息相关规范[19]。事实上,人脸识别技术不仅能对特定个体进行识别,在某些情况下还可以进一步追踪到个体的行为偏好、活动轨迹、财产状况等隐秘性信息。人脸信息是一种与隐私交叠的个人信息,若要对它进行有效保护,亟待对其特殊性展开分析。

其一,人脸信息半公地悲剧模型明晰了人脸信息半公地属性及相互作用,促使我们从整体上兼顾两种不同目的下的人脸信息使用。该模型表明,信息技术的发展潜力,建立在海量的个人信息基础之上。若人脸信息没有得到应有的保护,信息主体利益受损,就会影响其共享信息的意愿。如果每个主体都不愿意共享信息,人脸识别技术的发展与推广将受到大大的限制。为了确保信息收集和使用活动的可持续性,以及行业的健康长远发展,人脸信息半公地属性对技术发展与隐私保护提出了更高的要求。

其二,人脸信息半公地模型提供了一个新的视角,认识到“知情同意”隐私保护制度的局限。“知情同意”制度聚焦于信息主体和信息处理者之间的关系,将权利赋予主体,由主体来掌握。而人脸信息半公地模型则将人脸信息看作是一个有限的资源系统,更关注信息处理者之间的关系。由于信息治理需要成本如资金、时间等,信息处理者必定将成本外部化,那么所有“理性”的信息处理者也会不采取治理行动。如此,信息处理者之间就出现了集体行动困境[20],信息主体对人脸识别技术的信任会因这种“不作为”而过度消耗,导致半公地悲剧的出现。因此,隐私保护不能只依赖向信息主体赋权的方式,还需协调信息处理者之间的行动。

其三,人脸信息半公地模型重塑了信息主体和信息处理者在人脸信息隐私保护中的关系。信息主体对人脸识别技术与应用的信任决定了人脸信息共享的数量,直接影响着信息处理者的利益。对于公众而言,保护人脸信息就是维护自身的利益和权益;而对信息处理者而言,保护人脸信息则有利于信息收集和利用的持续性,也是符合自身利益的。如此,在半公地理论视野下,信息主体和信息处理者之间的利益可以进行统一,利益的一致性使双方关系从“针锋相对”转向“合作”。

2. 伦理原则有学者从不同角度探讨人脸信息隐私保护相关的伦理原则,如“最小必要原则、知情同意原则、不伤害原则和公正原则”构成防范和规制风险的原则[21],“自主性原则、最低限度原则、目的明确原则和公开透明原则”的应用原则[22]等。虽然上述原则在一定程度上有效,但是它们忽视了人脸信息的本质与属性,在具体情境中难以充分落实。因此,笔者看来,新的人脸信息隐私保护伦理原则可以归纳为:整体性原则、功利主义原则、公平正义原则与协调原则。

人脸信息的半公地属性要求隐私保护遵循整体性原则。整体性原则指的是从整体上兼顾两种不同目的下人脸信息的使用,即不仅重视两者的相互联系和相互作用,还要从时间维度和空间维度加以关注,制定符合其发展特点的措施,增强措施的针对性,以利于人脸信息的妥善保护,促进人与技术的协调发展。该原则主张把对象作为一个有机联系的整体,从对象本身所固有的各个方面、各种联系上来考察和认识它[23]。在整体性原则的指导下,我们将人脸信息隐私保护看作是一个有机联系的整体,由科技工作者、政府及其他决策者、企业和公众采取的保护措施而组成。在具体操作过程中,我们要重视各方做出的努力,也要看到保护措施之间的关系,不能从其所处环境和背景中割裂出来,反而需要尊重它在不同发展阶段的丰富性和特点,也要注意它所依赖和生存的环境。

功利主义原则主要来源于杰瑞米·边沁(Jeremy Bentham)[24]和约翰·斯图亚特·密尔(John Stuart Mill)[25]的功利主义思想。在人脸信息隐私保护中,该原则兼顾两种不同目的下的信息使用,主张效用最大化,即最大限度地挖掘、开发和实现人脸信息价值,同时尽可能降低隐私泄露风险,重视个体的隐私保护需求,以最大多数人的最大利益为核心。当利益发生冲突时,它“唯一赞成的自我牺牲,是为了他人的幸福或有利于他人幸福的某些手段而做出的牺牲”[25]20-21。根据悲剧模型,信息处理者的信息过度利用行为会影响到未来的切身利益,因此要自觉尊重和保护人的隐私,适时妥协让步自身利益;而信息主体也应对信息利用保持信心,在隐私得到保护的基础上,积极参与到人脸识别事业的健康持续发展中来。

公平正义原则源于约翰·博德利·罗尔斯(John Bordley Rawls)的正义原理[26],强调隐私保护的有效实施,要求各方利益得到合理的平衡,尽最大可能保证公平和正义。一般而言,“数据搜集者、使用者、生产者等群体,形成了一座数据‘金字塔’的知识权力结构”[27]。信息处理者掌握的信息与财富创造的关联性强,处于相对有利地位,而信息素养和能力存在差异的信息主体则处于“最差处境”。由于利益矛盾的存在,公平正义原则要求除了利益相关者之间的利益分配要合乎正义,政府与其他决策者也有责任发掘、建立和完善合作机制,对“最少受惠者”做好补偿,尽最大力量帮助最不利者群体,改善他们的处境,使他们享有的利益达到最大化,保障两者间的良性互动,以达成共识,实现双赢。

从总体上看,整体性原则、功利主义原则与公平正义原则之间是统一的、相互补充的。整体性原则从整体上关注和研究人脸信息的半公地属性及其隐私保护,功利主义原则侧重于调节自利的主体行为,使他们朝着共同的利益方向而行动,而公平正义原则主要调整主体之间因利益差异发生的摩擦。这三项伦理原则能够起到约束与调整人们行为的作用。但在人脸信息的应用过程中是不可避免会发生冲突的,因此需要一个协调原则来解决潜在的冲突问题,即具体权衡协调原则。它主要源于汤姆·彼彻姆(Tom Bcauchamp)和詹姆士·邱卓思(James Childress)的境遇优先说[28]以及张华夏的权重协调公理[29]。协调原则容许冲突的存在,要求在恰当的结合点和妥协点中做出协调,即必须通过具体境遇下的利益权衡来确定原则优先性,灵活地在整体性原则、功利主义原则与公平正义原则之间进行审慎明智的协调,使伦理原则与具体场景之间保持必要的张力,保证原则的相容性。

四、走出伦理困境的路径构建人脸信息隐私保护的伦理原则是人与技术协调发展的客观要求。目前我国人脸信息隐私保护机制尚未健全的情况下,我们应遵循新的伦理原则,探寻走出伦理困境的途径。

一是构建重复博弈的隐私保护机制,抑制机会主义动机,鼓励隐私保护行为。根据悲剧模型,当博弈只进行一次时,“理性”的信息处理者必定会选择自身利益最大化的策略,这时出现的纳什均衡只是一种平衡,并非是帕累托最优,倒使双方陷入个人理性与集体理性的冲突中,导致最优结果未能出现。但是,当博弈进行足够多次时,结局很可能是双方都选择了合作。促使信息处理者合作的机制来自于“以后是否继续合作”,“如果未来相对于现在是足够重要的话,双方的合作就会是稳定的”[30]。因此,构建重复博弈的隐私保护机制能够让信息处理者采取基于回报的合作方针。这就需要遵循整体性原则,从时间和空间维度上让“未来”变得更重要些,构建以信任、可持续为基础的隐私保护机制。此外,重复博弈机制的构建能够使信息处理者的目标从短期利益最大化转变为长期利益最大化,实现个人理性向集体理性的转化,体现功利主义原则的主张;还能够实现信息处理者与信息主体的长期良性互动,让参与者放弃不正义的原则[31],选择公平正义原则。

二是建立和完善多元主体的伦理责任体系,有利于实现人脸信息隐私保护的积极治理,预防并化解隐私风险。根据人脸信息隐私保护所涉及到的主要社会角色,我们将主体主要分为科技工作者、政府与其他决策者、企业以及公众。这四类主体的伦理行为是在一定的伦理意识和伦理责任之支配下,根据四个伦理原则标准,能动地进行善恶取舍的活动。不同主体感知风险的内容和能力存在差异,只有各主体都承担起自己的伦理责任,形成系统的、有机统一的科技伦理责任的多元主体机制时,科技事业才能真正造福于人类[32]。首先,技术成果转化本身就是一个复杂的过程,科技工作者比常人更准确地认识到其中的风险。这就要求他们将伦理原则贯穿于科技活动和实践应用中,肩负起预见、通告和建议等伦理责任和社会责任,客观评估人脸识别技术的应用及推广对隐私的影响。其次,政府及其他决策者作为公权力的行使者,应该自觉履行起事前预警和防范责任、事后救助和协调责任,担负起调整不同主体之间关系的责任[33],谋求科技决策的平衡与协调。再次,企业是人脸信息的重要处理者,需要肩负起相应的伦理责任[34],兼顾自身利益和社会效益,走可持续发展的道路。最后,公众既是技术的获益者,也是隐私保护的诉求者,应当提高承担伦理责任的意识和能力,积极主动地表达利益诉求和参与决策,承担起知情、批评、建议、申诉、控告及举报等伦理责任。

三是发挥各方优势,建立“自上而下”和“自下而上”相结合的混合保护策略。人脸信息的半公地属性决定了隐私保护需要多方主体的共同参与,各方主体都具有不可替代的位置,仅凭一己之力是很难解决困境的。“自下而上”,以政府及其他决策者、企业为主体:政府及其他决策者基于四个伦理原则,通过顶层设计协调各方利益,兼顾利益与公平,为人脸识别事业发展提供宽容的社会环境和有利的政策空间;而企业应该实现角色的转型升级,放眼长远利益,建立人脸识别行业自律监管框架,遏制投机主义行为。“自下而上”,以科技工作者、公众为主体:科技工作者应该充分发挥行业技术优势和创新能力,提高隐私保护的能力和积极性,加强与政府及其他决策者、企业和公众的联系;而公众应该增强自身的隐私保护能力,主动建言献策,履行监督责任。从长远来看,人脸信息隐私保护的治理完全依赖某个单方面是不现实的。人脸信息隐私保护,需要形成全方位的良性互动,既以基层探索实现风险可控,又能够依靠政府及其他决策者与企业的合作,在顶层设计中整体地把握人脸信息隐私保护的发展方向和节奏,为人脸识别技术的发展与推广注入双重动力,推动人脸识别事业行稳致远。

①

| [1] |

杨建军, 李童心. 人脸识别技术运用的法律原则.

南宁师范大学学报(哲学社会科学版), 2020, 41(3): 37-47.

|

| [2] |

王鸿. 人脸识别技术应用的现行规制综述及立法趋势分析.

东北师大学报(哲学社会科学版), 2022(2): 97-101.

|

| [3] |

郭春镇. 数字人权时代人脸识别技术应用的治理.

现代法学, 2020, 42(4): 19-36.

|

| [4] |

石佳友, 刘思齐. 人脸识别技术中的个人信息保护——兼论动态同意模式的建构.

财经法学, 2021(2): 60-78.

|

| [5] |

宁宣凤, 吴涵, 李沅珊, 等. 人脸识别信息的内涵与合规难题.

《上海法学研究》集刊, 2020, 37(13): 85-91.

|

| [6] |

付大学. 论共享平台半公地属性与混合治理路径.

经济法研究, 2019, 22(1): 272-287.

|

| [7] |

Smith H E. Semicommon Property Rights and Scattering in the Open Fields.

The Journal of Legal Studies, 2000, 29(1): 131-169.

|

| [8] |

阳晓伟. 半公地理论研究的演进与展望.

湖北经济学院学报, 2019, 17(3): 5-15.

|

| [9] |

Bertacchini E, De Mot J, Depoorter B. Never Two Without Three: Commons, Anticommons and Semicommons.

Review of Law & Economics, 2009, (1): 163-176.

|

| [10] |

Heverly R A. The Information Semicommons.

Berkeley Technology Law Journal, 2003, 18(4): 1127-1189.

|

| [11] |

付大学. 个人信息之半公地悲剧与政府监管.

首都师范大学学报(社会科学版), 2019(1): 53-62.

|

| [12] |

庆启宸. 个人信息保护制度的重构: 由公地悲剧模型展开.

情报理论与实践, 2019, 42(10): 29-34.

|

| [13] |

Rainel, Duggan M. Pew Research Center, Privacy and Information Sharing, 2016. https://www.pewresearch.org/wpcontent/uploads/sites/9/2016/01/PI_2016.01.14_PrivacyandInfoSharing_FINAL.pdf. [2016-01-14]

|

| [14] |

姜野. 由静态到动态: 人脸识别信息保护中的“同意”重构.

河北法学, 2022, 40(8): 126-144.

|

| [15] |

田野. 大数据时代知情同意原则的困境与出路——以生物资料库的个人信息保护为例.

法制与社会发展, 2018, 24(6): 111-136.

|

| [16] |

何继业, 张小飞. 科技理性与价值理性的分离及伦理风险.

西南民族大学学报(人文社科版), 2007(3): 149-152.

|

| [17] |

焦艳玲. 人脸识别的侵权责任认定.

中国高校社会科学, 2022(2): 117-128,160.

|

| [18] |

王俊秀. 数字社会中的隐私重塑——以“人脸识别”为例.

探索与争鸣, 2020(2): 86-90,159.

|

| [19] |

冉克平. 论个人生物识别信息及其法律保护.

社会科学辑刊, 2020(6): 111-120.

|

| [20] |

James Alt. Thoughts on Mancur Olson's Contribution to Political Science 1932~1998.

PublicChoice, 1999, 98: 1-4.

|

| [21] |

胡晓萌, 李伦. 人脸识别技术的伦理风险及其规制.

湘潭大学学报(哲学社会科学版), 2021, 45(4): 134-138.

|

| [22] |

尚世芳, 焦艳玲. 人脸识别技术应用中个人信息保护的伦理思考.

中国医学伦理学, 2021, 34(9): 1133-1138.

|

| [23] |

吕国忱. 科学认识的整体性原则.

哲学研究, 1984(10): 45-52.

|

| [24] |

边沁. 道德与立法原理导论. 时殷弘译. 北京: 商务印书馆, 2000.

|

| [25] |

约翰·穆勒. 功利主义. 徐大建译. 上海: 上海人民出版社, 2008.

|

| [26] |

约翰·罗尔斯. 正义论. 何怀宏等译. 北京: 中国社会科学出版社, 2001: 60-61.

|

| [27] |

杨建国. 大数据时代隐私保护伦理困境的形成机理及其治理.

江苏社会科学, 2021(1): 142-150,243.

|

| [28] |

Beauchamp, Tom L, Childress James F. Principles of Biomedical Ethics. Oxford: Oxford University Press, 1994: 105–326.

|

| [29] |

张华夏. 现代科学与伦理世界. 北京: 中国人民大学出版社, 2010: 97–99.

|

| [30] |

罗伯特·阿克塞尔罗德. 合作的进化. 吴坚忠译. 上海: 上海人民出版社, 2007.

|

| [31] |

张华夏. 博弈论与霍布斯问题——兼答陈晓平教授的批评.

自然辩证法通讯, 2000, 22(5): 85-89.

DOI: 10.3969/j.issn.1000-0763.2000.05.024. |

| [32] |

梁红秀. 科技伦理责任的主体系统及责任区分.

科技管理研究, 2009, 29(5): 556-558.

|

| [33] |

赵清文. 公共危机管理中政府的伦理责任.

云南社会科学, 2011(1): 15-18.

DOI: 10.3969/j.issn.1000-8691.2011.01.003. |

| [34] |

周祖城. 论企业伦理责任在企业社会责任中的核心地位.

管理学报, 2014, 11(11): 1663-1670.

DOI: 10.3969/j.issn.1672-884x.2014.11.012. |

2023, Vol. 13

2023, Vol. 13