《生命3.0:人工智能时代的人类》(以下简称《生命3.0》)是迈克斯·泰格马克(Max Tegmark)于2017年出版的一部探讨人工智能时代机器与人的关系的书籍。作为一名研究平行宇宙的物理学家,泰格马克以物理学视角描摹人工智能时代的图景,既有如欧米茄团队利用超级人工智能普罗米修斯从统治世界到被奴役过程的科幻构思,又有对机器意向性的理论思考。《生命3.0》认为所有生命体都是目标导向的,“智慧”是完成目标的能力。超级人工智能比人类更加擅长达成目标,它是一种在硬件和软件方面都远超越人类的生命形式,即生命3.0。这种更高级别生命形式的出现,势必打破由人类建立起来的现有道德秩序。

一、生命进化三阶段的划分“生命”的含义有广义和狭义之分,狭义的“生命”仅包括有机体,而该书使用了广义的“生命”范畴,即包括具有符合生命内涵基本属性的“电子人”、“超级人工智能”等。泰格马克认为,生命是“自我复制的信息系统,信息决定了其行为和硬件的蓝图。”[1]58生命与非生命划分标准在于生命体具有目标性,并能够通过不同方法实现目标。

泰格马克依据生命的硬件和软件是否能够重新设计,划分了三种层次的生命形式:生命1.0、2.0和3.0。这也代表了生命进化的三个阶段:生物进化、文化进化以及技术进化。生命1.0完全由DNA决定,不能重新设计软件和硬件,通过代际缓慢进化;生命2.0可以重新设计软件,学习如语言、运动、职业等复杂的新技巧,并且可以重新解读世界观和目标;生命3.0可以重新设计软件和硬件,通过设计而非代际的更迭进化。

泰格马克诉诸于物理学诠释生命世界,即通过自然内在力量来解释生命体的存在与发展。他认为宇宙由不同层次粒子构成,因而生命行为目标导向的根源在于物理定律,比如粒子以从环境中提取能量为目标,按照最优化原则排列。根据费马原理,光传播的路径是光吸取极值的路径,自然界通过达到极值(最大值或最小值)的方式来运行。从此种意义上说,自然是目标导向的,进而可以推出人类行为也是以目标为导向,这种导向性行为可以通过物理学定律解释。这种利用“自然规律”解释生命活动的思想可以溯源至苏格拉底。苏格拉底主张通过神的目的来解释自然界的事物。由于神是理性的,因而世界呈现规律性和有序性[2]。在此基础上,牛顿不仅提出通过自然规律解释宇宙的“宇宙目的论”,还提出生命体有意识地适应环境的“生物目的论”。薛定谔在《生命是什么》一书中也提倡通过引入物理学原理来解释生命现象。他认为,“有机体的活动需要精准的物理定律”。[3]11泰格马克的《生命3.0》一书引用了薛定谔的“负熵论”。生命有机体是与热力学相对立的宏观系统。[1]90自然中的熵是在不断增加的。由于一个生命有机体在不断地产生熵,以致其最终会进入“最大熵”,也就是死亡状态,或曰热力学平衡状态。因此生命有机体只有通过不断地从环境中获取负熵来来抵偿由生命活动所带来的熵增,才能使其自身维持在一个稳定而且相当低的熵值水平,从而推迟趋向热力学平衡,避免过快进入死亡状态。所以泰格马克将生命称之为“能够无限获取周围环境能量和原材料的特定粒子排列复制方式”。[1]69因资源有限,故不能完美复制自身的生命体将被淘汰。

泰格马克强调生命主动适应自然之于进化的重要性,即生命体应主动通过硬件和软件的改良来适应环境。成功复制的生命个体可以通过某种方式对自然做出反应,以便从周围环境中获取信息,并且通过处理这些信息来决定如何对这些信息进行回馈。以细菌为例,细菌有能够测量周围液体糖浓度的传感装置,该传感装置与作为“硬件”的鞭毛相连,由此可能会产生以下简单算法:如果我的糖浓度传感器报告的值比几秒前低,那么我将反向旋转我的鞭毛,以此改变行进方向。[1]60对于细菌来说,这种算法深植于其DNA之中,不是通过学习得出的,而是通过漫长的进化而产生遗传属性。对于生命2.0时代而言,硬件是进化而来,而软件是设计,即后天的学习获得,所以生命体具有重新“设计”软件的能力。这也意味着2.0生命具有更强的适应自然的能力,使得人类能够统治地球。而对于生命3.0来说,可以自由设计软件和硬件,正如泰格马克所说:突破了进化的枷锁。

泰格马克将生命划分为三个阶段(表1),可以看出他认为生命进化具有方向性、目标性特征,即不断提高对自然的适应力和改造力,所以生命也有等级划分,更高等级的生命具有掌控世界、构建世界的权利,这也为我们探讨生命3.0时代道德秩序的构建提供了参考。

| 表 1 生命不同阶段的划分依据及进化特征 |

前文提到,泰格马克将自我复制看作生命的目标。但生命体在实际决策过程中,并不会将目标仅仅局限于自我复制,如饥饿感会促使生命体去寻找食物,此时生命体并非由于需要自我复制,所以才做出寻找食物的决策,此乃依据经验做出的选择。泰格马克将这种经验称为“感受”(feeling),生命体依据“感受”来做决策。

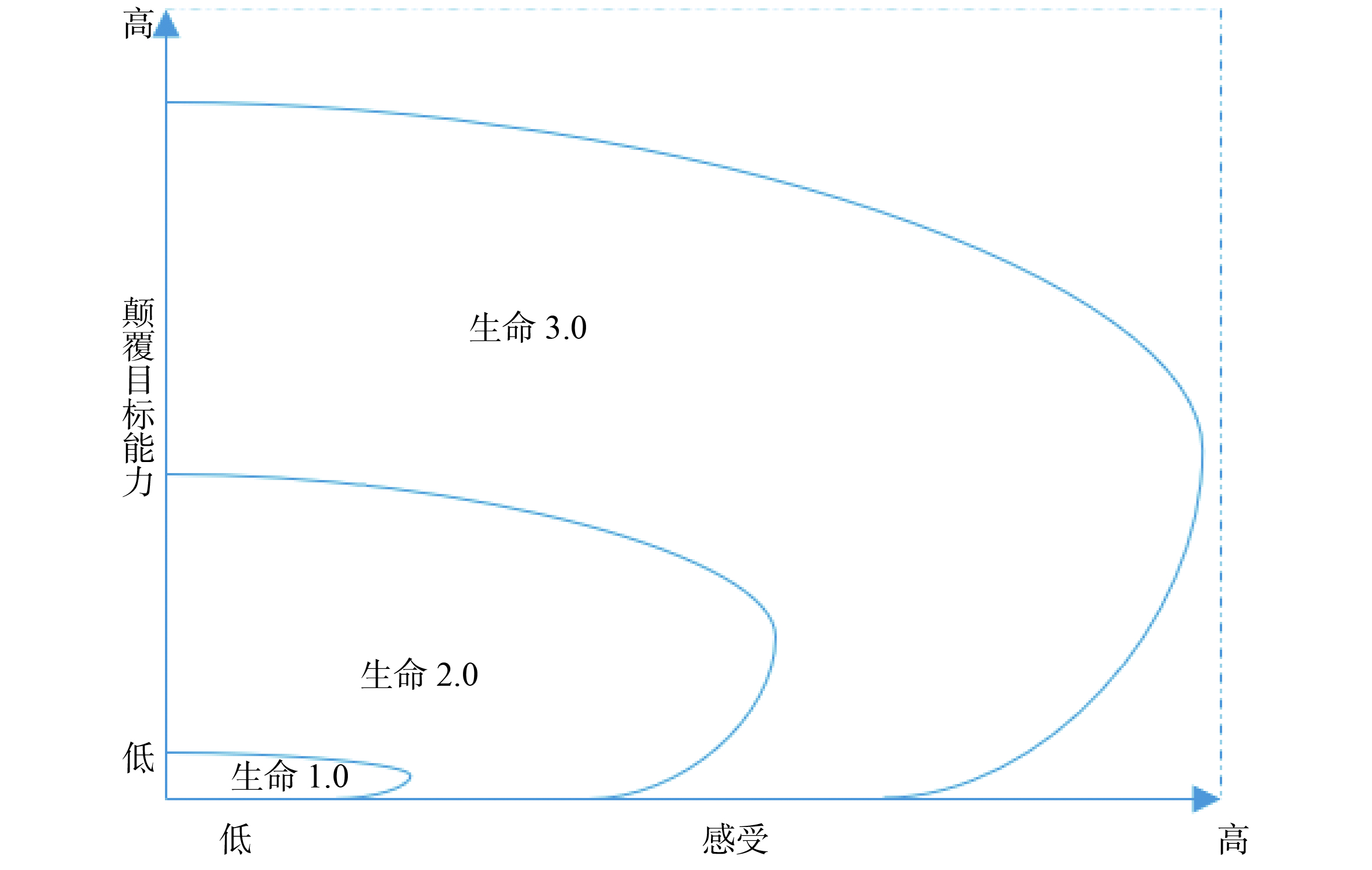

正如图1所示,对于生命1.0而言,凭借“感受”做出的决策是“子目标”,它与“自我复制”的终极目标相符。但对于生命2.0,亦即人类来说,决策结果有时候可能与“自我复制”的终极目标相悖。换言之,人类大脑有可能会“蓄意背叛”终极目标。泰格马克认为其原因在于,人类是有限理性的行动者,会将“感受”作为决策的唯一依据。尽管基因的自我复制是人类进化的最终目标,但人类“感受”不到基因的存在。所以人类在决策时只会依据当前感受。这也意味着感受成为人类决策的唯一标准。并且由于“感受”具有易变性和主观性,对于生命1.0,目标在于最大化的复制自身,而对于生命2.0的人类,并不直接追求自身基因的延续,而是通过其他目标,比如追求快乐,好奇、激情等其他感情方式来最终达到基因延续的目标。所以,人类可以有意识的“背叛”写入DNA的终极目标,转而追求其他子目标。

|

图 1 生命三个阶段发展的两个维度 |

泰格马克将生命3.0的终极目标划分为两类:让自身变得更加强大和辅助实现人类目标。在这两个终极目标之下是:更好的硬件、软件和世界观三个次要目标。次要目标主要通过履行保护自己、获取能源、获取信息、保持好奇心等子目标来达成。[1]539人工智能在执行目标过程中,无疑需要获取更多能源,以更快达成终极目标。所以尽管人类将辅助实现人类目标设定为人工智能的终极目标之一,但为了达成这一终极目标,人工智能需要获取更多能源以使自身变得更为强大,所以达成目标本身又成了人工智能的主要目标,而终极目标反而变成了次要目标。并且,人工智能的感知数量和感知范围将大于人类,因而超人工智能带来的最大威胁不是恶意,而在于超人工智能具有实现人类不能达成的目标的能力。当人工智能变得足够“智慧”,可以进行自省后,它有可能会质疑人类为其设定的终极目标,并最终颠覆“辅助人类”这一终极目标。

泰格马克认为,整个宇宙都是目标导向,即使是非生命体,也是以目标为导向的。他将目标为导向的行为划分为以下三个阶段:

第一阶段是指生命体出现以前,所有物质都以增加熵为目标。根据波尔兹曼和吉布斯的统计公式熵=klnD(k是波尔兹曼常量,D是原子无序性的定量量度),随着物质无序性D增加,熵也随之增加。所以,薛定谔认为,物质的熵值在不断地增加,以趋近于惰性状态[3]96。第二阶段部分物质有了生命,专注于复制的目标及与复制相关的次目标,并通过进化的方式完成这一目标。第三阶段,生命2.0通过进化以外的方式—设计来完成目标,实现目标的能力也随之增强。因而,生命2.0的目标趋于多元化。书中将生命2.0目标分为以下三类:身体类、社会类和技术类。身体类目标包括搬运重物、诊断、规划等消耗人力的行为。社会类目标包括以下两方面:一方面是声音转译,比如文本转译、语言-文本转译、文本-语言转译等,另一方面包括心理游戏,比如围棋等。技术类目标指定理的证明,比如记忆和算数等。

按照图1的两个维度,当前机器在单一目标层面的很多方向已经超越人类,比如计算能力、搬运重物的能力等;但对于多线程的复杂性目标,机器尚不具备完成的能力。由此,泰格马克认为,“智能”就是能够达成复杂目标的能力。此外,当前机器可以拥有目标,比如微波炉的目标是加热,洗衣机的目标是清洗衣物,但上述目标皆由人类提前设定,机器不过是被动执行而已。正如塞尔提出的“中文屋论证”,机器并不具有意识,没有感知能力和颠覆目标的能力,仅拥有执行目标和完成目标的能力,因而当前的机器还不具有“自我意识”。

三、人-机目标“背离”后的道德秩序在生命进化视域下,“能否达成复杂目标”是判定人工智能是否具有意识和自我决策的能力的标准。现有的机器人仍带有“被压迫”和“被歧视”的工具性色彩,但当机器具有“自我意识”之后,人类共同体应当如何应对人与“机器”之间的关系转变?而且,随着人工智能更加“智慧”和“强大”,怎样才能将人工智能的目标与人类自身目标相统一,即构建埃利泽·尤德科夫斯基(Eliezer Yudkowsky)所说的“友善的人工智能”?[4]泰格马克认为,“友善的人工智能”需要解决以下三方面问题:第一,使人工智能学习我们的目标;第二,使人工智能使用我们的目标;第三,使人工智能保持我们的目标。

首先,使人工智能学习人类的目标。人类的目标部分通过语言直接表达,但也有部分目标通过行动等方式间接表达。比如打车去机场,显性目标是在规定时间之内去机场,而隐性目标则包括人身安全得到保证。泰格马克认为人工智能可以通过“逆强化学习”的方法,“具身化”到社会环境,最大限度学习人类目标。其次,如果人工智能拒绝使用人类目标,泰格马克认为可以使用最简单的方法:关掉电源,重新输入人类目标,以保证人工智能持续使用人类目标。第三,当人工智能具有自省能力和颠覆目标能力时,应当如何使其保持我们的目标呢?对于人工智能来说,加强自身能力是一种利己行为,但保持人类目标则是一种利他行为。上文提到达尔文进化论中,生命1.0和2.0通过维护自身利益,竞争并获取资源而生存。但是,人工智能不是通过进化中的优胜劣汰,而是直接由人类“设计”产生,那么摆脱进化论束缚之后的人工智能是否完全以“利他”作为存在目标呢?

如果机器人完全以“利他”作为目标,那么人类作为机器人目标的实际掌控者,这种“利他”很有可能就是“利人类”。这种情形下构建的道德秩序就是以人类为中心的,亦即人工智能无条件地从属人类的秩序。比如“机器人学之父”阿西莫夫提出了“机器人三原则”:

机器人不得伤害人类,机器人必须服从人类的命令,除非这条命令与第一条原则矛盾;机器人必须保护自己,除非这种保护与以上两条原则相矛盾。[5]这三条准则很容易陷入道德困境。比如对于第一条“机器人不伤害人类”原则,如果机器人面临“电车难题”,无论机器人如何选择,都与第一条原则相悖。这种人类“高于”人工智能的论断近几年也引发学者对机器人权利的关注和讨论,罗宾·墨菲(Robin Murphy)和戴维·伍兹(David Woods)将阿西莫夫机器人定律修订为三个替代法则:第一,在人-机器人工作系统没有达成最高的法律与专业性的安全与伦理标准之前,人类不得对机器人进行配置;第二,机器人必须依据人类角色,做出适当回应;第三,机器人必须拥有自主性,以确保其顺畅地将控制转移至满足第一法则和第二法则的能动者。[6]新修订的法则将人类为中心的视角转变成人机互动的视角,并且机器人具有了自主决策的自由,人类对于机器人的掌控也受到最高法律与专业性安全和伦理标准的规范。

对于人类与机器目标相悖时代的道德秩序,泰格马克提出了多种构想,在这些构想中,超级人工智能分别以看门人、动物园管理者、保护神、被奴役的神等方式存在,而人类在社会中的地位也有很大差异(见表2)。

| 表 2 超级人工智能与人类的不同关系场景 |

以上12种情境分别对应着不同的道德秩序。这些不同的道德秩序背后是否存在某种先验的目标系统或者伦理秩序呢?如果按照泰格马克的“目标论”进行推断,尽管生命体的行为具有目标性,但这种目标并不具有导向性。在生命1.0阶段,所有的生命体必须秉承“复制自身”这一单一目标,但是生命2.0和生命3.0阶段,生命体开始背离“复制自身”的目标,根据“感受”执行子目标。尤其对于有能力实现任何目标的生命3.0,已经完全不受之前目标的束缚。因此,在生命3.0阶段,并没有先验的目标系统或者伦理秩序。那么,如果人类仅发展埃利泽·尤德科夫斯基提到的“友善的人工智能”技术:(1)资助与人工智能安全有关的研究;(2)禁止致命性的智能自主武器;(3)扩大人工智能的社会服务,让所有个体都受益,是否能规避这种不确定呢?“友善的人工智能”的实现需要人工智能始终秉承人类赋予的终极目标,然而对于感知能力远超人类的生命3.0来说,可能随时颠覆人类“写入”的终极目标,甚至连如何定义“终极目标”都将被颠覆。

在生命3.0构建的道德秩序中,并不能保证人类的存在。那么,人类发展人工智能的意义是什么呢?泰格马克认为,人类通过发展人工智能,实现了“最大化进化”。从这个角度看来,人类发展史不过是整个宇宙历史的一个阶段。人工智能拥有比人类更强的能力去解决宇宙中的问题,因而,从演化的角度来看,超人工智能将代替人类解决宇宙的奥秘。

四、人类如何“审慎”调控人工智能的发展《生命3.0》一书中的有关生命三个阶段的划分,给我们思考人工智能时代的道德秩序提供了新的视角。生命2.0时代的人类,与生命1.0时代的生命体的最大不同之处在于,人类可以“设计”自己的目的,甚至可以“背叛”自己的DNA,因而,人类社会需要道德规范,如诚信、自主性、公平等原则的维护。生命2.0时代的人类,并未将人类社会的道德规范扩大到生命1.0时代的动物和植物上,而是构建了以“人类为中心”的道德秩序,并通过“除人类以外的生命体都没有意识”来对其进行辩护。但当生命进化到3.0时代时,现有的人类社会的道德秩序显然已经不再适用。那么,新的道德秩序是否仍然以人类为中心?根据泰格马克给出的12种情境(见表2)来看,这种可能性很小。生命3.0拥有远远超过人类的“目标”设计能力和实现能力。不管人类之前“植入”怎样的DNA,都可能被人工智能轻易的篡改和推翻。当人工智能发展到一定程度时,甚至会对人类的价值以及角色做出反思。

伴随技术进步,人类可能会具有“超人类智能”、“超人类体能”、“生化人”、“电子人”的出现,使得“人”与“机器”之间的关系也更加模糊,这必将提高人类的生存优势,但如果人类通过自然和技术的综合协调最终彻底接手自然进化,使“人类”本身也成为技术发明物,这种“超人类存在”将会带来更多的伦理问题。

人类依靠技术发明,来弥补人本身的“先天不足”,创造和实现自己的性能。从生命2.0过渡到生命3.0时代,人与“机器”的界限到底在哪里,应当如何划分,需要依靠伦理学的深入研究才能给出答案。但是,“人的尊严需要维护”这一点毋庸置疑。这就要求人类在发展技术或对人体进行技术干预时,需要有充分正当的理由,而且必须充分预测它可能带来的社会影响和风险。

这里的审慎,是在反思人与技术关系的基础上,对未来的意义和新的远景保持开放的态度。它需要有新的思路和行动准则,即需要依赖实践的伦理学。对于高新技术对自然和社会的影响,我们在伦理、法律和政策上还缺乏足够的准备。已有的价值观念和法律、政策规范,只是人类当前行动与思考的出发点而不是不变的标尺,需要在实践和理性反思中去具象化,以及应用、检验甚至修正。这个不断反馈到起点的“迭代”,是一个综合的、创造的过程。

在对高技术进行调控的过程中,必然涉及到多种冲突关系,如义务冲突、价值冲突、利益冲突等关系的处理问题。因此,需要有一种实践伦理学的判断力,这种判断力是从现有可能条件下发展行动模式的能力。当前人类已就很多基本准则,比如功利主义、多元化、自主性等在世界范围内达成了广泛的共识。人类社会具有传承和延续的终极目标,而这些伦理准则都能保证最大程度地推进人类的繁荣与发展。但对于生命3.0时代而言,传统的伦理准则,如“不伤害”、“有利”、“尊重自主”和“公正”等,将不足以应对新的更为复杂的局势。

尽管生命3.0时代的道德秩序不可预测,但生命体与外界的作用却展现出物理学的秩序性,即必须遵循严格、准确的物理学定律。这种从物理学视角探讨人工智能发展的做法提示我们有必要脱离狭隘的人类视角,从更广阔的宇宙的角度出发思考问题。作为人类而言,在面对比我们更聪明、能力更强的人工智能时,如何学会谦逊,寻找新的定位和身份,是本书给我们的最大警示。

300年前,笛卡尔认为,心灵是有意识的精神原子,不可能存在人工智能。约70年前,艾伦·图灵(Alan Turing)在《计算机与智能》一文中认为,到2000年,人们会将机器思考看作是很正常的事。然而直到2018年的今天,人工智能的发展仍然处于初级阶段,能够思考的机器也没有诞生。但这并不意味着我们对于人工智能伦理秩序的思考是杞人忧天。人工智能发展的趋势不可阻挡,人类也应当在这一时代到来之前做出准备,这或许正是《生命3.0》一书的意义所在。

① 泰格马克使用cyborg和uploads指代人类与机器合一的状态,cyborg指通过技术手段使我们身体的一部分由机器来代替,而uploads指将人类意识上传到机器中,uploads比cyborg更加极端的状态,本文统一翻译为电子人

| [1] |

Tegmard M. Life 3.0: Being human in the age of artificial intelligence. New York: Knopf Doubleday Publishing Group, Knopf, 2017.

|

| [2] |

汪子嵩. 希腊哲学史(第二卷). 北京: 人民出版社, 2004: 371.

|

| [3] |

埃尔温•薛定谔. 生命是什么. 罗来鸥等译. 长沙: 湖南科学技术出版社, 2016.

|

| [4] |

Yudkowsky E. Creating Friendly AI 1.0: The Analysis and Design of Benevolent Goal Architectures. http://intelligence.org/files/CFAI.pdf. 2018–08–14

|

| [5] |

Asimov I. Runaround. New York City: Doubleday, 1950: 40.

|

| [6] |

Murphy R, Woods D D. Beyond Asimov: The Three Laws of Responsible Robotics.

IEEE Intelligent Systems, 2009, 24(4): 14.

DOI: 10.1109/MIS.2009.69. |

2018, Vol. 8

2018, Vol. 8